Capire come si muovono le foglie – con quale velocità vibrano, quanto si piegano, con quale frequenza oscillano – non è una semplice curiosità botanica. È la chiave per distribuire meglio i trattamenti fitosanitari, usare meno prodotto chimico, ridurre l’inquinamento e aumentare l’efficienza delle colture. Ma misurare i movimenti non è semplice. Le foglie sono leggere, flessibili, irregolari: applicare sensori direttamente su di esse rischia di alterarne il comportamento. Le tecniche ottiche senza contatto offrono una soluzione più elegante, ma durante l’irrorazione le gocce possono coprire i punti di riferimento, riflettere la luce e rendere instabile il tracciamento. È qui che entra in gioco l’intelligenza artificiale.

Un team di ricercatori cinesi ha sviluppato un metodo capace di acquisire in modo affidabile i parametri di movimento delle foglie anche in condizioni complesse: quando sono parzialmente nascoste dalle gocce, quando oscillano rapidamente o quando l’immagine è disturbata da riflessi e interferenze. La soluzione si basa sul modello YOLOv8, ulteriormente potenziato con un modulo di ottimizzazione specificamente progettato per il tracciamento delle foglie, aprendo la strada a un monitoraggio più preciso, robusto e in tempo reale. Ma di cosa si tratta?

Come funziona il metodo

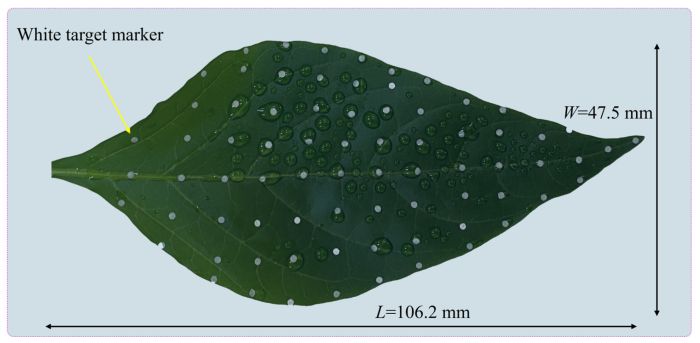

Per capire come una foglia reagisce all’impatto di una pioggia di agrofarmaci, i ricercatori hanno utilizzato piante di peperone della varietà Tianshuai101, coltivate in condizioni controllate. Sulla superficie delle foglie sono stati applicati minuscoli marcatori bianchi, leggerissimi, progettati per non alterarne il comportamento naturale ma renderne visibili anche le più piccole vibrazioni. Il tutto è stato registrato da due telecamere ad altissima velocità, capaci di catturare 3000 fotogrammi al secondo e ricostruire il movimento anche in tre dimensioni.

Foglia di peperone con punti bersaglio. Fonte: Agronomy

A questo punto entra in gioco l’intelligenza artificiale. Il sistema funziona in tre fasi principali: prima, individua i punti sulle foglie usando un modello di intelligenza artificiale (YOLOv8), opportunamente potenziato con un modulo di attenzione spaziale (SAM), che consente di concentrarsi sulle parti più rilevanti dell’immagine, ridurre l’interferenza dei riflessi delle gocce e riconoscere correttamente i punti anche se parzialmente coperti. Successivamente, un secondo algoritmo, DeepSORT, collega i punti tra un fotogramma e l’altro, assegnando a ciascuno un’identità (ID) e prevedendone la posizione anche quando temporaneamente nascosto dagli spruzzi. Infine, dalle posizioni registrate nel tempo si calcolano velocità, spostamento e traiettoria delle foglie.

Ma quanto è davvero efficace la nuova versione potenziata di YOLOv8?

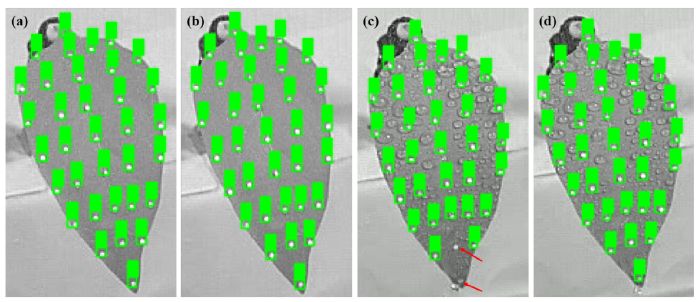

Per scoprirlo, i ricercatori hanno testato il modello in tre scenari di difficoltà crescente: senza occlusione, con una copertura leggera delle foglie (2%) e con un’occlusione moderata (5%), simile a quella che avviene durante una vera irrorazione. In condizioni ideali, entrambi i modelli funzionano molto bene, e il sistema migliorato mostra solo un lieve vantaggio, dimostrando di non introdurre complessità inutili quando non servono. La vera differenza emerge quando le cose si complicano. Con poche gocce presenti, il modello ottimizzato individua meglio i punti di riferimento, riduce gli errori e gestisce più efficacemente i riflessi, aumentando la precisione di circa il 4%. Con un’occlusione più marcata, invece, si nota il vero salto di qualità: mentre il modello base perde molti punti di tracciamento, la versione migliorata mantiene oltre l’80% di accuratezza, con un incremento vicino al 20%, nessun falso positivo e un errore di posizionamento ridotto di oltre la metà. Gran parte del merito va al modulo di attenzione integrato, che permette alla rete di “concentrarsi” sulle informazioni davvero rilevanti anche tra riflessi e disturbi visivi.

Risultati del riconoscimento in diverse condizioni di occlusione. ( a ) Risultato del riconoscimento YOLOv8 quando il rapporto di occlusione è 0%; ( b ) Risultato del riconoscimento YOLOv8 migliorato quando il rapporto di occlusione è 0%; ( c ) Risultato del riconoscimento YOLOv8 quando il rapporto di occlusione è 5% (la freccia rossa indica i punti target non identificati); ( d ) Risultato del riconoscimento YOLOv8 migliorato quando il rapporto di occlusione è 5%.

Non solo: nei test su sequenze lunghe fino a un minuto, il sistema mostra anche una stabilità nettamente superiore. Cambia meno volte l’identità dei punti tracciati, interrompe molto più raramente le traiettorie e continua a seguire le foglie anche quando si sovrappongono, la luce varia o le gocce aumentano. Il risultato è un tracciamento fluido e preciso, capace di trasformare oscillazioni quasi impercettibili in dati concreti su velocità, spostamento e deformazione, informazioni fondamentali per rendere l’irrorazione più efficiente, ridurre gli sprechi e rendere l’agricoltura più sostenibile.

Federica Del Vecchio

© fruitjournal.com